Definición del Perceptrón

El perceptrón es la red neuronal más básica que existe de aprendizaje supervisado que data de los años 50.

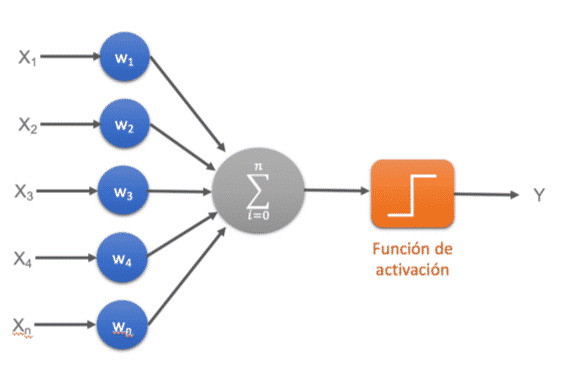

El funcionamiento del perceptrón es muy sencillo, simplemente lee los valores de entrada, suma todos las entradas de acuerdo a unos pesos y el resultado lo introduce en una función de activación que genera el resultado final.

En resumen, el perceptrón aprende de manera iterativa siguiendo estos pasos:

- Inicializar pesos y umbrales

- Bucle: hasta resultado de pesos sea aceptable

- Bucle: para todos los ejemplos

- Leer valores de entrada

- Calcular error

- Actualizar pesos según el error

- Actualizar pesos de entradas

- Actualizar el umbral

- Bucle: para todos los ejemplos

Nota: Solo es capaz de representar funciones lineales debido a que no dispone de capas ocultas como por ejemplo el perceptrón multicapa.

Arquitectura

Conjunto de entradas x1,…xn

Representan las entradas de la red neuronal.

Pesos sinápticos w1,…wn

Cada entrada tiene un peso que se va ajustando de forma automática a medida que la red neuronal va aprendiendo.

Función de agregación, Σ

Realiza el sumatorio de todas las entradas ponderadas por sus pesos.

Función de activación, F

Se encarga de mantener el conjunto de valores de salida en un rango determinado, normalmente (0,1) o (-1,1)

Existen diferentes funciones de activación que cumplen este objetivo, la más habitual es la función sigmoide.

Salida, Y

Representa el valor resultante tras pasar por la red neuronal.

0 comentarios