Definición de Red Neuronal Recurrente

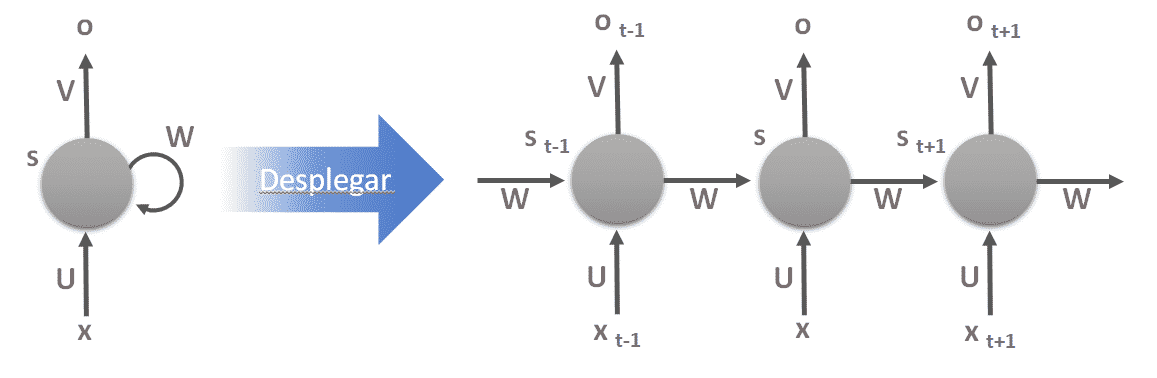

Una red neuronal recurrente no tiene una estructura de capas definida, sino que permiten conexiones arbitrarias entre las neuronas, incluso pudiendo crear ciclos, con esto se consigue crear la temporalidad, permitiendo que la red tenga memoria.

Las redes neuronales recurrentes son muy potentes para todo lo que tiene que ver con el análisis secuencias, como puede ser el análisis de textos, sonido o video.

Existe multitud de tipos de redes neuronales dependiendo del número de capas ocultas y la forma de realizar la retropropagación, a continuación se detallarán las más conocidas y los usos de estas.

Tipos de redes neuronales recurrentes

Redes recurrentes Simples – SRN o Elman

Las redes neuronales recurrentes son la arquitectura base sobre la que se implementan el resto. Se diferencian del resto de redes en que incorporan la retroalimentación lo que se consigue crear la temporalidad, permitiendo a la red que tenga memoria.

Son utilizadas para problemas como reconocimiento de la voz o reconocimiento de la escritura a mano.

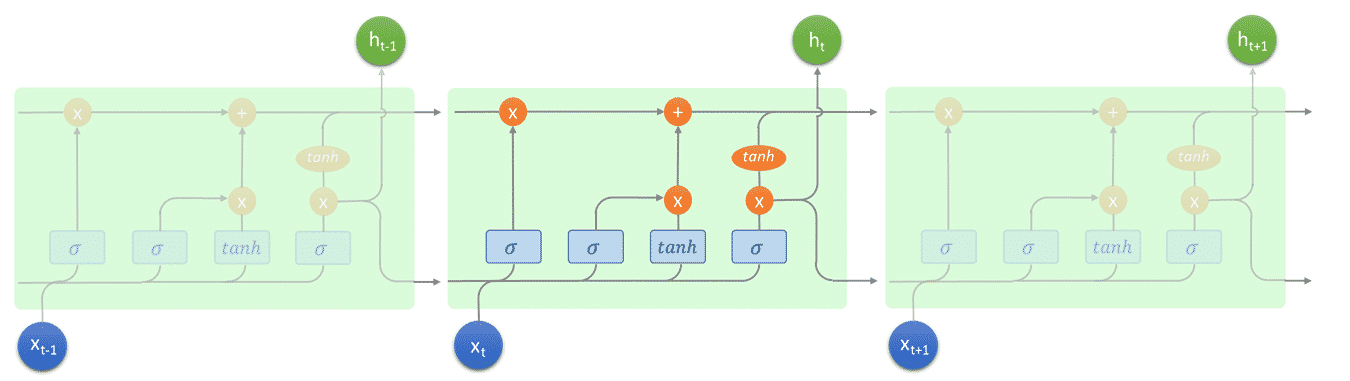

Redes LSTM

Las redes LSTM (Long Short Term Memory) están compuestas por unidades LSTM y son un tipo especial de red neuronal recurrente descritas en 1997 por Hochreiter & Schmidhuber.

Las redes neuronales recurrentes convencionales presentan problemas en su entrenamiento debido a que los gradientes retropropagados tienden a crecer enormemente o a desvanecerse con el tiempo debido a que el gradiente depende no solo del error presente sino también los errores pasados. La acumulación de errores provoca dificultades para memorizar dependencias a largo plazo.

Estos problemas son solventados por las redes LSTM, para ello incorporan una serie de pasos para decidir que información va a ser almacenada y cual borrada.

La unidad de memoria LSTM contiene tres puertas que controlan el modo en que la información fluye dentro o fuera de la unidad.

- Puerta de entrada controla cuando la información nueva puede entrar en la memoria.

- Puerta del olvido controla cuando se olvida una parte de la información, lo que permite a la celda discriminar entre datos importantes y superfluos, dejando así sitio para nuevos datos.

- Puerta de salida controla cuando se utiliza en el resultado de los recuerdos almacenados en la celda.

La celda dispone de un mecanismo de optimización de las ponderaciones basado en el error de salida de la red resultante, que controla cada puerta. Este mecanismo se suele implementar con el algoritmo de capacitación, BPTT.

Finalmente destacar las redes LSTM se utilizan para compresión de textos de lenguajes naturales, reconocimiento de escritura a mano, reconocimiento de voz, reconocimiento de gestos, captura de imágenes.

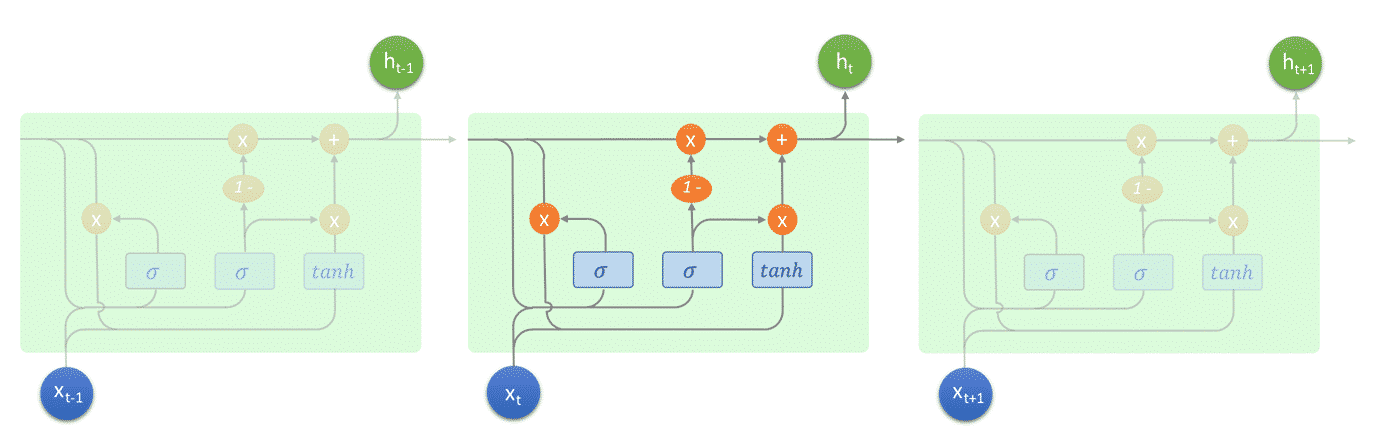

Redes GRU

Las redes GRU (Gated recurrent unit) están compuestas por unidades GRU y son un tipo especial de red neuronal recurrente descritas en 2014 por Kyunghyun Cho et al.

La unidad de memoria GRU contiene dos puertas que controlan el modo en que la información fluye dentro o fuera de la unidad.

- Puerta de actualización y una puerta de reajuste. La puerta de actualización indica cuánto del contenido de las celdas anteriores hay que mantener.

- Puerta de reajuste define cómo incorporar la nueva entrada con los contenidos anteriores de la celda.

Nota: Se puede modelar una red neuronal recurrente estándar simplemente estableciendo la puerta de reajuste a 1 y la puerta de actualización a 0.

Las redes GRU son más simple que las LSTM, debido a que:

- Tienen menos parámetros.

- Carecen de puerta de salida.

- Capacitar más rápidamente.

- Más eficiente en su ejecución.

Por ello las redes GRU han demostrado que presentan un mejor rendimiento en conjuntos de datos más pequeños. Sin embargo, las redes LSTM al operar con conjuntos de datos más amplios, puede ser más expresivas y proporcionar mejores resultados ante contextos complejos.

Interesante el blog, no se si me puede usted ayudar a realizar una tarea con redes neuronales el trabajo tiene que ver con estimación de pose…